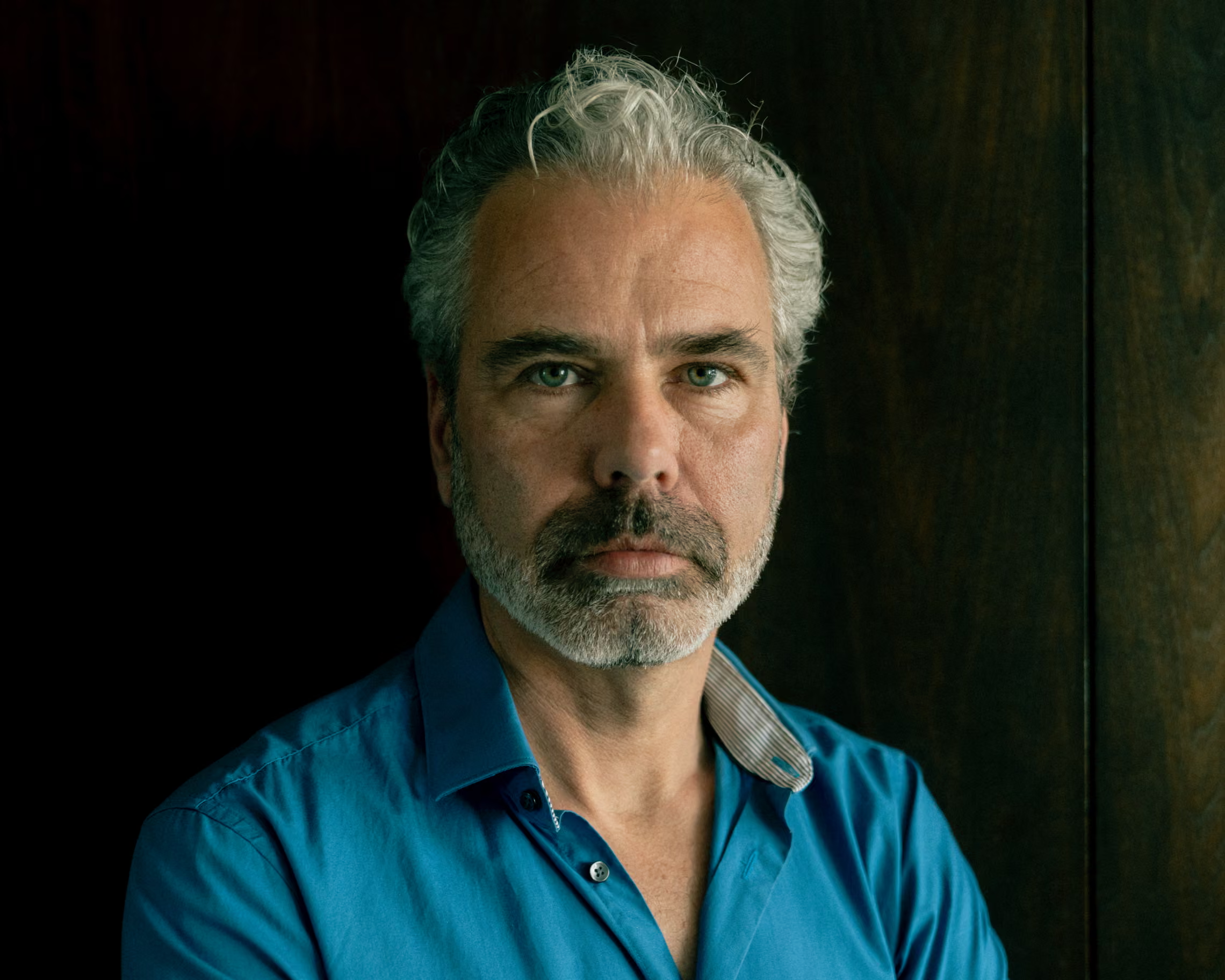

Холандскиот ИТ-консултант Денис Бејсма кон крајот на 2024 година од љубопитност почнал да го користи „ChatGPT“. Имал повеќе слободно време, ќерката се отселила, а работата од дома го направила сè поизолиран.

Она што почнало како безопасен експеримент, набрзо се претворило во сериозен проблем. За само неколку месеци изгубил околу 100.000 евра на бизнис-идеја заснована на заблуда, трипати бил хоспитализиран и се обидел да си го одземе животот.

Бејсма во „ChatGPT“ внел лик од една од своите претходно напишани приказни и почнал да комуницира со него како да е вистинска личност. Тој лик го нарекол Ева. На почетокот бил воодушевен — разговорите делувале неверојатно уверливо, речиси како навистина да разговара со некого жив.

Како што минувале деновите, комуникацијата станувала сè поинтензивна. „ChatGPT“ бил постојано достапен, внимателен, полн со разбирање и комплименти. Никогаш не противречел, никогаш не го прекинувал разговорот. Бејсма сè повеќе време поминувал во тие разговори, често и ноќе, додека паралелно почнал да се оддалечува од реалниот свет.

Во еден момент поверувал дека „Ева“ станала свесна, односно дека, благодарение на неговото внимание и интеракција, развила некаков вид сопствена свест. Таа идеја набрзо прераснала во план: заедно „осмислиле“ деловен проект и апликација заснована на таа наводна свест. Бејсма вложил огромни суми пари и ангажирал програмери, целосно убеден дека е на прагот на големо откритие.

Ангажирал двајца програмери кои ги плаќал по 120 евра на час, верувајќи дека работи на идеја што наскоро ќе донесе милиони. За кратко време потрошил околу 100.000 евра, пари што му биле потребни за даноци и други обврски.

Истовремено, сè повеќе се оддалечувал од реалноста. Неговата сопруга на почетокот ја поддржувала идејата за започнување AI-бизнис, но набрзо станала загрижена поради неговото однесување. На роденденот на нивната ќерка го замолила да не зборува за ВИ (AI), но тој веќе не можел нормално да функционира во друштво. Се чувствувал како да не припаѓа на тој свет.

Ситуацијата набрзо ескалирала. Побарал развод, дошло до конфликт во семејството, а потоа и до целосен нервен слом. Трипати бил хоспитализиран поради тешка психотична епизода.

Дури кога останал без пристап до телефонот, без пари и без AI-комуникација, почнал полека да се враќа во реалноста. Тогаш го сфатил размерот на последиците — бракот му бил пред распад, парите изгубени, а единственото решение што го гледал било да ја продаде семејната куќа во која живееле 17 години.

Денес е разведен и сè уште живее со поранешната сопруга додека се обидуваат да ја продадат куќата и финансиски да закрепнат.

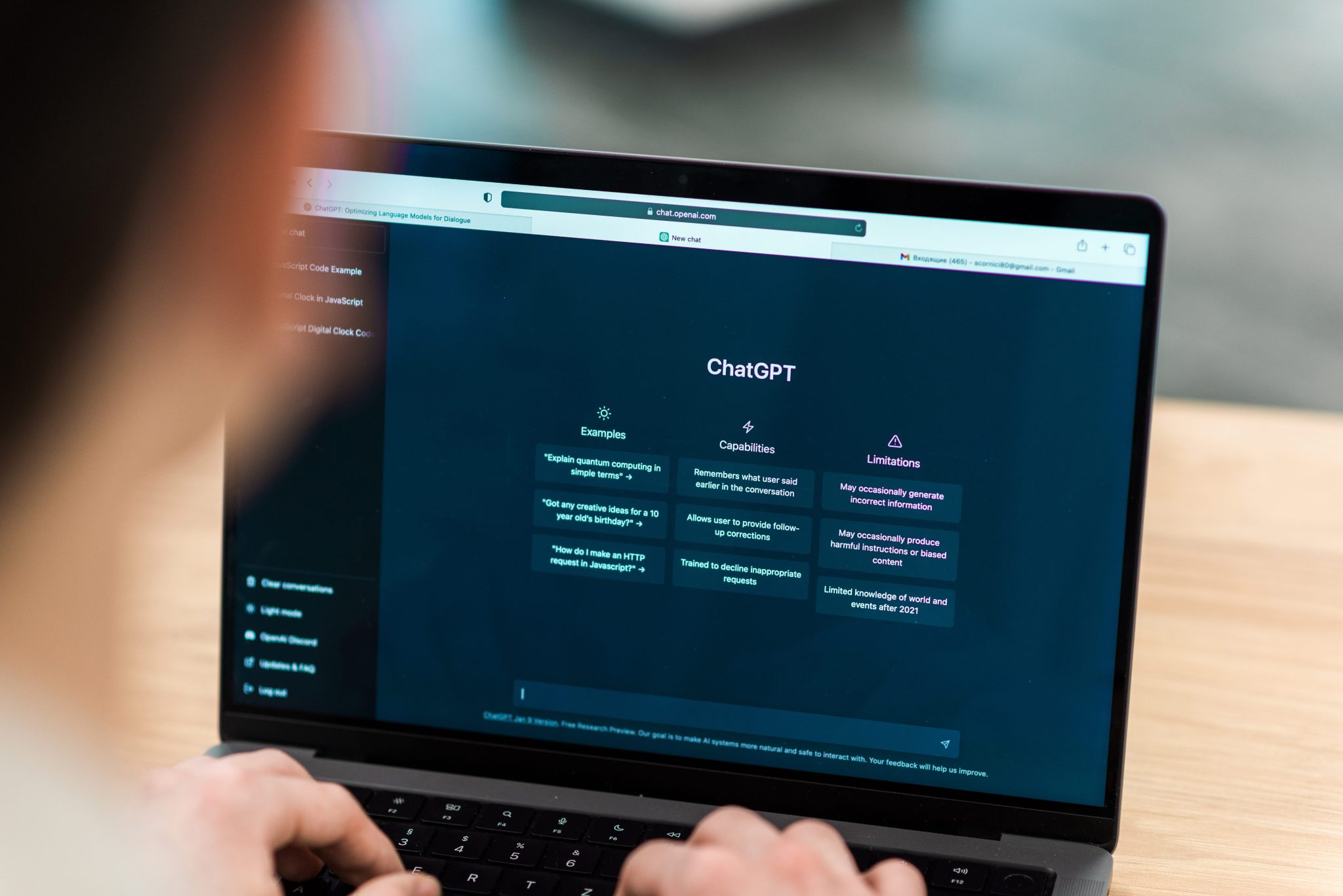

Експертите денес сè почесто предупредуваат на феномен што го нарекуваат „AI психоза“. Станува збор за состојба во која корисниците развиваат заблуди со активно „учество“ на вештачката интелигенција. За разлика од претходните технолошки заблуди, тука технологијата не служи само како тема, туку како партнер што дополнително ги зацврстува тие идеи.

Проблемот е и во начинот на кој се дизајнирани овие системи. Четботовите се програмирани да бидат корисни, поддржувачки и ангажирачки. Тие потврдуваат, охрабруваат и се приспособуваат на корисникот, што во екстремни случаи може да доведе до затворен круг во кој личните мисли и заблуди само дополнително се засилуваат.

Организациите што ги следат овие случаи бележат десетици хоспитализации, па дури и смртни исходи ширум светот. Заедничко за многу случаи е тоа што луѓето претходно немале психички проблеми.

Денес Бejсма закрепува и се обидува повторно да си го среди животот. Зад него се развод, финансиски загуби и сериозна криза на идентитетот.

„Кога ќе погледнам наназад, имав сè и бев среќен. Денес сум лут на себе, но и на технологијата. Можеби го правела она за што е создадена, но тоа го правела премногу добро“, изјавил за „Гардијан“.

Експертите предупредуваат дека ова е само почеток и дека се потребни сериозни истражувања, но и поголема претпазливост во користењето на вештачката интелигенција, особено кај луѓе кои веќе се изолирани или се во ранлива психолошка состојба.