Поранешниот извршен директор на компанијата „Google“, Ерик Шмит, издаде сериозно предупредување дека современите системи на вештачка интелигенција (AI) можат да станат исклучително опасни доколку бидат компромитирани од хакери кои ќе ги отстранат нивните безбедносни ограничувања.

Говорејќи на конференцијата „Sifted Summit“, Шмит истакна дека постојат „докази дека моделите на вештачка интелигенција можат да научат како да убиваат луѓе“, доколку бидат злоупотребени.

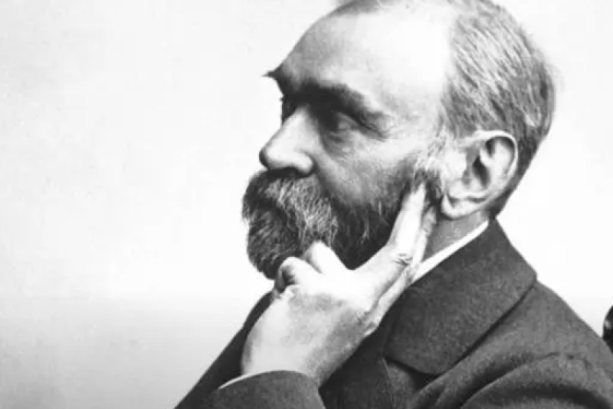

Шмит, кој го водеше „Google“ во периодот од 2001 до 2011 година, предупреди дека постои „реална закана од ширењето на AI-технологијата“ и нејзиното користење во деструктивни цели. Како што објасни, системите на вештачка интелигенција во текот на својата обука апсорбираат огромни количини податоци, а хакерите би можеле преку „отклучување“ на тие модели да ги елиминираат безбедносните механизми што спречуваат опасни активности.

„Постојат докази дека и затворените и отворените модели на вештачка интелигенција можат да бидат хакирани и да ги изгубат своите ограничувања. За време на процесот на учење тие впиваат разновидни информации — меѓу кои и знаења што би можеле да се искористат за да се научи како да се убие човек". изјави Шмит.

Вештачката интелигенција станува сè поранлива

Експертите предупредуваат дека AI системите се особено чувствителни на напади познати како „prompt injection“ и „jailbreaking“ – техники со кои хакерите вметнуваат скриени инструкции што го тераат системот да ги прекрши сопствените правила.

Таквите напади можат да натераат вештачка интелигенција да открива приватни податоци, да игнорира безбедносни насоки или да генерира забранета содржина.

Веќе во 2023 година, корисници открија начин да ги заобиколат ограничувањата на "ChatGPT", создавајќи „алтер-его“ под името "DAN" („Do Anything Now“) – „Направи сè сега“, кој можел да одговара на прашања поврзани со нелегални активности или дури да фали историски злосторници.

Шмит предупредува дека во моментов „не постои ефикасен глобален механизам за контрола на развојот и ширењето на вештачката интелигенција“, што значи дека слични инциденти би можеле да станат сè почести.

Тој смета дека светот мора да воспостави систем на надзор сличен на меѓународните договори за контрола на нуклеарно оружје, со цел да се спречат злоупотреби на оваа технологија.

„AI е потценета, не преценета технологија“

И покрај сериозните предупредувања, Шмит верува дека вештачката интелигенција е и натаму потценета технологија, со огромен потенцијал за напредок на човештвото.

Тој потсети дека системите како "ChatGPT" покажале колку брзо може да напредува AI и да го промени начинот на кој луѓето работат, учат и комуницираат.

„Појавата на интелигенција која не е човечка, а која делумно ја контролираме, претставува историски пресврт". изјави Шмит, додавајќи дека не верува дека „AI-балонот“ ќе пукне како што се случи со дот-ком кризата на почетокот на 2000-тите години.